Dave Asprey, a teljesítménynövelő élelmiszerekkel és más táplálék-kiegészítőkkel foglalkozó Bulletproof vezetője szerint a biohacking (vagy csináld magad – DIY – biológia) „a külső és belső környezet biológiánk feletti teljes kontrollt célzó megváltoztatásának művészete és tudománya.”

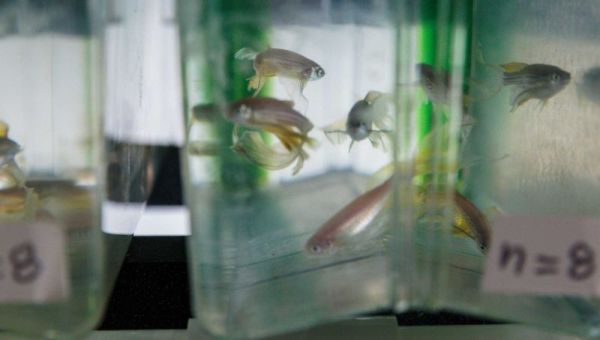

Egyre gyakrabban találkozunk a legváltozatosabb esetekre ráhúzható kifejezéssel. Josiah Zayner korábbi NASA-alkalmazott például a CRISPR génszerkesztő technológiát használva, DNS-injekciókat, Asprey őssejteket fecskendez be magának és infravörös fényben fürdik/szaunázik, de a kézbe és más testrészekbe ültetett és ajtókat nyitó, a vér cukorszintjét stb. ellenőrző chipek, az öregedést hátráltató gyógyszerek, fiatalabb személyek vérének idősebbekébe történő átömlesztés – amiben Peter Thiel nagy jövőt lát – is mind idetartoznak.

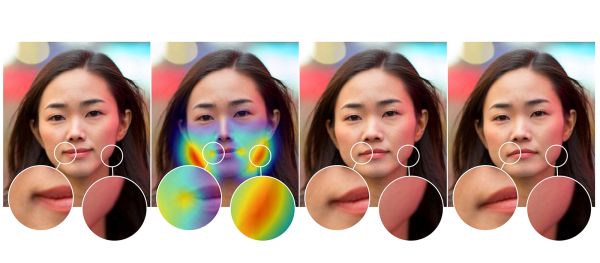

A kiindulási pontot jelentő Szilícium-völgy mellett más helyeken szintén egyre népszerűbb jelenség lassan életstílusnak tekinthető. Legismertebbek a saját testüket és agyukat a jobb teljesítmény érdekében csúcstechnológiás megoldásokkal módosító biohackerek. Elképzeléseik a transzhumanizmus azon alapelvére rímelnek, mely szerint a Homo sapiens evolúciója nem ért véget, saját kezünkbe vesszük sorsunk irányítását, és változatos technológiák (robotika, MI, nanotech, genetika stb.) segítségével „feljavítjuk” az emberi állapotot.

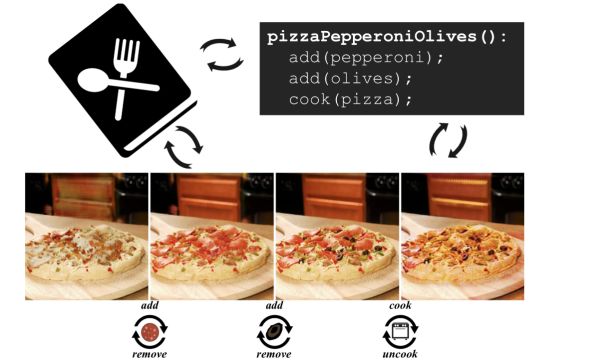

Asprey bizakodik, hogy technikáival akár 180 évig elélhet. Az ő és a többi biohacker szótárában is gyakran szerepelnek a számítástudományban jól ismert kifejezések: „optimalizálás”, „frissítés” stb. Mivel saját maguk, testük szinte minden aspektusát számszerűsítik, köreikben népszerűek a viselhető (wearable) technológiák, többek között alvásmintázataikat mérik velük.

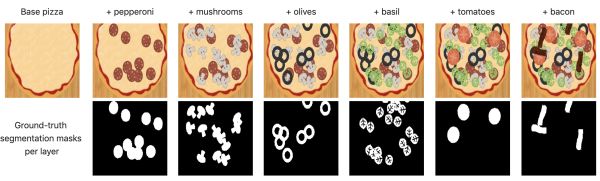

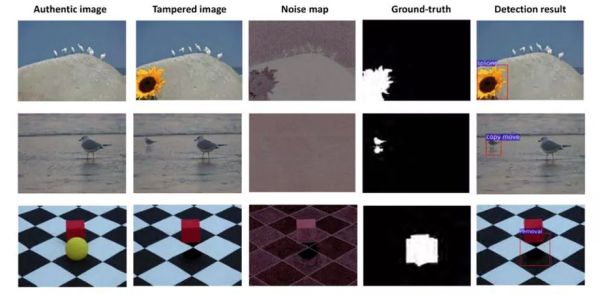

Egyes tevékenységek tudományosan teljesen megalapozottak, kísérletek által igazoltak, mások viszont bizonytalan kimenetelű, a kívánt hatást el nem érő, esetleg káros kísérletezések, vagy annyira újak (például a CRISPR), hogy még nem ismerjük az összes mellékhatásukat. Saját genomunk „barkácsolásával” például szándékunkon kívüli és egyes betegségekre való hajlamot növelő mutációkat is létrehozhatunk.

Az érvényben lévő szabályozás és a törvények nem tudnak sokat kezdeni a szélsőséges esetekben az „emberi” határait feszegető tevékenységekkel. Ezek a tevékenységek nem feltétlenül illegálisak, hanem egyszerűen nincs még rájuk vonatkozó törvény.

Nem minden biohacker kísérletezik saját magával. Sokan szélesebb tömegekhez szeretnék eljuttatni a tudomány eredményeit, tenni akarnak valamit a klímaváltozás ellen, vagy komfortzónánkból kirángató műalkotásokkal figyelmeztetnek a 21. századi valóságra.