Általában nagy infokom vállalatok fejlesztenek nagy nyelvi modelleket. Az ok világos: kisebb cégek nem tudják megengedni maguknak sem az egyre gigantikusabb adatsorokat, sem a szintén napról napra növekvő, szükséges számítási kapacitásokat.

Független kutatóknak ezért nyílik ritkán lehetőség a modellek teljesítményének értékelésére, az esetleges elfogult és káros kimenetek kimutatására.

Egyes szervezetek, például a BigScience és az EleutherAI részben erre a tendenciára reagálva, saját nagy nyelvi modelleket tettek közkinccsé. A modellek nyílt forrásúak, kutatók hozzájuk férhetnek.

A BigScience 2021 májusában egyéves workshop-sorozatot indított azzal a céllal, hogy átláthatóbb, hitelesíthetőbb és a lakosságot jobban reprezentáló nyílt forrású mesterségesintelligencia-modelleket dolgozzanak ki. Az együttműködés eredményeként mutatták be a csak angol, maximum 11 milliárd paramétert használó TO nyelvimodell-családot.

Az elmúlt két évben, a GPT-3 indulásától, változni látszik a tendencia – a Google, a Meta és az OpenAI is nyílt hozzáférést biztosít modellekhez. Értékes kutatásokat és más kereskedelmi projekteket akarnak bátorítani vele.

A hetekben megjelent a BigScience – szintén a workshopokon alapuló – legújabb modellcsaládja, a BLOOM. A kollektívában a világ különböző pontjain található 250 intézet ezernél több kutatója dolgozik együtt, a BLOOM pedig az eddigi legnagyobb nyílt forrású nyelvi modell.

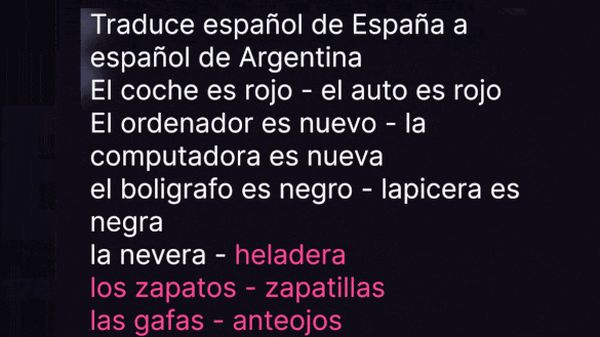

A BLOOM az OpenAI GPT-3-ját utánozza. Szabványos 1,6 milliárd terabájtos adatsoron gyakoroltatták, hogy 46 természetes nyelv és 13 programozói nyelv bármelyikén generáljon kimeneteket.

Az adatok nagy részét manuálisan vizsgálták át, hogy elkerüljék a részrehajlást. Szignifikáns mennyiségű pornótartalmat azért szűrtek ki, mert szerintük más adatsorokban túlreprezentált a téma.

A gyakorlást az adatok és a modell 384 GPU-n (grafikus feldolgozóegység) történő elosztásával gyorsították fel. Jelenleg hat méretben érhető el, a legkisebb 351 millió, a legnagyobb 176 milliárd paraméteres. A teljes változathoz bárki hozzáférhet, aki rendelkezik Hugging Face fiókkal.