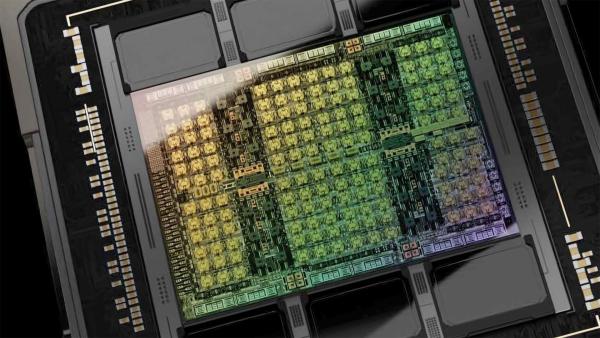

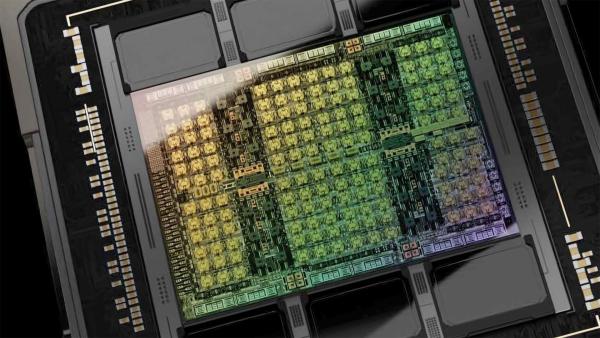

A Reuters értesülései szerint a mesterségesintelligencia-fejlesztésekhez nélkülözhetetlen grafikus feldolgozóegységek, GPU-k piacát vezető Nvidia a következő két hónapban módosítani fog H20 chipjén. Egy kicsit „lebutítja” az eredeti modellt, amellyel meg tudja kerülni az Egyesült Államok szigorú kiviteli szabályozását.

A lépés egyértelműen az amerikaiak legnagyobb riválisának, Kínának szól. A nagyvállalat közölte fontosabb kínai ügyfeleivel, köztük vezető felhőszámítás-szolgáltatókkal, hogy a chip módosított változata júliusra lesz kész. A lebutított H20 jelzi: az Nvidia meg akarja őrizni jelenlétét a kelet-ázsiai ország hatalmas piacán.

A kínai piac annak ellenére kulcsfontosságú az amerikai infokom-óriásoknak, hogy Washington mindent megtesz a rivális gyengítéséért, és növeli erőfeszítéseit, amelyekkel képes megakadályozni az ország hozzáférését a legfejlettebb félvezető technológiákhoz. Az Nvidia lépése érthető, mert például 2024-es bevételeinek tizenhárom százaléka, tizenhétmilliárd dollár jött a kínai piacról.

A H20 az Nvidia kínai értékesítésre engedélyezett leghatékonyabb MI-chipje volt, az amerikai hatóságok áprilisban viszont tájékoztatták a nagyvállalatot, hogy ezentúl exportengedélyre lesz szüksége a termékhez. A cég a módosított chip fejlesztéséhez irányelvként használandó új technikai küszöbértékeket dolgozott ki. A specifikációkkal, például jócskán csökkentett memóriakapacitással az eredetihez képest jelentősen lebutul a chip. A vásárlók persze megváltoztathatják a konfigurációját, így pedig értelemszerűen a teljesítményét is.

Sem az Nvidia, sem az USA Kereskedelmi Minisztériuma nem kommentálta az értesülést. Kína stratégiai jelentőségét mindenesetre jól szemlélteti, hogy Jansen Huang, a nagyvállalat vezérigazgatója néhány nappal a H20 új exportengedély-követelményének bejelentését követően Pekingbe látogatott, ahol kiemelte mennyire fontos cége számára az ottani piac.

Az Nvidia legkifinomultabb chipjeit érintő exportkorlátozások 2022 óta vannak érvényben, az USA az MI-verseny elvesztése mellett a potenciális katonai alkalmazásoktól is tart. Magát a H20-at 2023 októberében mutatták be.

Kínai techóriások, köztük az Alibaba, a Tencent, a TikTok-anyacég ByteDance növelték H20-rendeléseiket, miközben az országban megjelent a sokkal alacsonyabb költségen előállított, az amerikai csúcsmodellekkel egyenértékű MI, a DeepSeek startup R1-e. A szintén kínai (sencseni) HiSilicon félvezetőgyártó áprilisban bejelentett Ascend 920 chipjétől pedig helyi szakértők H20-szintű teljesítményt várnak.

Január óta mindenesetre tizennyolcmilliárd dollár értékben rendeltek globálisan a H20-ból.

A Reuters értesülései szerint a mesterségesintelligencia-fejlesztésekhez nélkülözhetetlen grafikus feldolgozóegységek, GPU-k piacát vezető Nvidia a következő két hónapban módosítani fog H20 chipjén. Egy kicsit „lebutítja” az eredeti modellt, amellyel meg tudja kerülni az Egyesült Államok szigorú kiviteli szabályozását.

A lépés egyértelműen az amerikaiak legnagyobb riválisának, Kínának szól. A nagyvállalat közölte fontosabb kínai ügyfeleivel, köztük vezető felhőszámítás-szolgáltatókkal, hogy a chip módosított változata júliusra lesz kész. A lebutított H20 jelzi: az Nvidia meg akarja őrizni jelenlétét a kelet-ázsiai ország hatalmas piacán.

A kínai piac annak ellenére kulcsfontosságú az amerikai infokom-óriásoknak, hogy Washington mindent megtesz a rivális gyengítéséért, és növeli erőfeszítéseit, amelyekkel képes megakadályozni az ország hozzáférését a legfejlettebb félvezető technológiákhoz. Az Nvidia lépése érthető, mert például 2024-es bevételeinek tizenhárom százaléka, tizenhétmilliárd dollár jött a kínai piacról.

A H20 az Nvidia kínai értékesítésre engedélyezett leghatékonyabb MI-chipje volt, az amerikai hatóságok áprilisban viszont tájékoztatták a nagyvállalatot, hogy ezentúl exportengedélyre lesz szüksége a termékhez. A cég a módosított chip fejlesztéséhez irányelvként használandó új technikai küszöbértékeket dolgozott ki. A specifikációkkal, például jócskán csökkentett memóriakapacitással az eredetihez képest jelentősen lebutul a chip. A vásárlók persze megváltoztathatják a konfigurációját, így pedig értelemszerűen a teljesítményét is.

Sem az Nvidia, sem az USA Kereskedelmi Minisztériuma nem kommentálta az értesülést. Kína stratégiai jelentőségét mindenesetre jól szemlélteti, hogy Jansen Huang, a nagyvállalat vezérigazgatója néhány nappal a H20 új exportengedély-követelményének bejelentését követően Pekingbe látogatott, ahol kiemelte mennyire fontos cége számára az ottani piac.

Az Nvidia legkifinomultabb chipjeit érintő exportkorlátozások 2022 óta vannak érvényben, az USA az MI-verseny elvesztése mellett a potenciális katonai alkalmazásoktól is tart. Magát a H20-at 2023 októberében mutatták be.

Kínai techóriások, köztük az Alibaba, a Tencent, a TikTok-anyacég ByteDance növelték H20-rendeléseiket, miközben az országban megjelent a sokkal alacsonyabb költségen előállított, az amerikai csúcsmodellekkel egyenértékű MI, a DeepSeek startup R1-e. A szintén kínai (sencseni) HiSilicon félvezetőgyártó áprilisban bejelentett Ascend 920 chipjétől pedig helyi szakértők H20-szintű teljesítményt várnak.

Január óta mindenesetre tizennyolcmilliárd dollár értékben rendeltek globálisan a H20-ból.