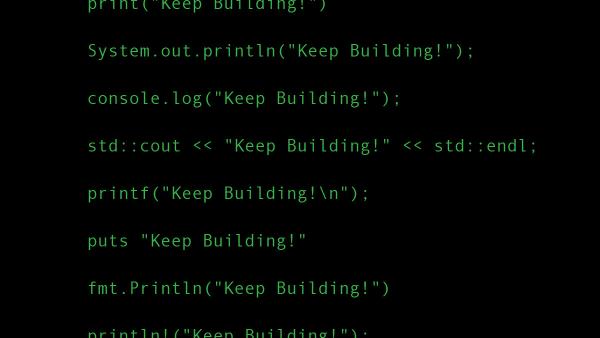

A világhírű gépitanulás-szakértő Andrew Ng sokkal jobban ért a Pythonhoz, mint a JavaScripthez, viszont az utóbbi időben több JavaScript-kódot írt mesterséges intelligencia (MI) támogatásával.

Mit jelent ez?

Azt, hogy az MI-vel támogatott kódírással (AI-assisted coding) a speciális programozási nyelvek veszítenek jelentőségükből. Persze fontos elsajátítani valamelyiket, mert így tanulják meg kulcsfogalmakat, és fejlesztőknek is komoly segítség jól ismert nyelvvel dolgozni, ugyanakkor az MI-vel jelentősen bővülnek a lehetőségek, többen valósíthatják meg kreatív (programozói) elképzeléseiket.

Ng háttere a gépi tanulás és a weboldalak, szoftveralkalmazások felhasználók által soha nem látott elemeinek tervezése és módosítása, a back-endfejlesztés. Az MI-vel támogatott kódolással viszont kevésbé ismert nyelvekkel is könnyedén épít a weboldalak és appok felhasználói interakciók tárgyát képező részét, front-end rendszereket is.

A generatív MI-vel a szintaxis kevésbé fontos, így egy mérnök szimultán lehet Python-, JavaScript-, TypeScript-, C++-, Java-, sőt, még Conol-fejlesztő is. Idővel talán már nem is Python- vagy C++-fejlesztőkről, hanem egyszerűen csak fejlesztőkről beszélünk.

A különféle nyelvek mögötti fogalmak, elvek megértése viszont változatlanul fontos marad. Ng ezért hangsúlyozza egy nyelv megtanulásának jelentőségét. Ha ismerjük például a Pythont, jó alapunk van nagy nyelvmodellek (LLM-ek) promptolásához, hogy Pythonban vagy más nyelveken generáljanak kódokat nekünk. Ha tisztában vagyunk valamelyest ezekkel az elvekkel, és az egyik programozási nyelvről egy hasonló feladatokat más szintaxissal megoldó másikra váltunk, jobban elboldogulunk, és a generált kódot is jobban fogjuk érteni. Ha kevesebbet tudunk róluk, kevésbé leszünk hatékonyak az LLM-mel történő kódiratásban. Ha például egy Python-fejlesztő JavaScriptes front-endprogramozásra vált, sokat profitálhat az ilyen rendszerek mögötti elvek megtanulásából. Pontosabban promptolja az LLM-et, jobban kezeli az esetleges hibákat.

Tanulság? Ahogy a több nyelven folyékonyan beszélő emberek is könnyebben kommunikálnak másokkal, úgy fejlesztők számára az LLM-ek is leegyszerűsítik a különböző környezetekben történő rendszerépítést.