Mennyire vagyunk képesek beszéde alapján következtetni egy személy kinézetére?

A beszédgenerálás módjának közvetlen következménye, hogy a kettő, a beszéd és az arc között erős kapcsolat áll fenn. Hallgatás közben mentális modellt építünk az illetőről – kora, neme, szájformája, arccsont-szerkezete, ajakmérete stb. mind hatással van a beszédmódjára. A nyelv, az akcentus, a gyorsaság, a kiejtés szintén fontos tényezők.

Az MIT (Massachusetts Institute of Technology) Számítástudomány és Mesterséges Intelligencia Labor (CSAIL) kutatói erre a kérdésre keresték a választ, és rövid hangfelvételeket használva igyekeztek arcképet készíttetni beszélő személyekről.

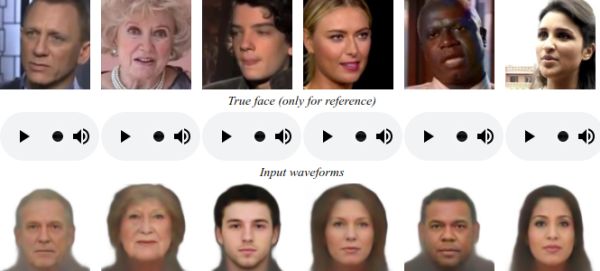

Mély ideghálót terveztek és többmilliós internetes, YouTube-anyagon megerősítéses tanulással gyakoroltattak. Gyakorlás közben megismerte a hang és az arc közötti kapcsolatokat, így az MI az illetők több fizikai tulajdonságát (korát, nemét, színét stb.) megjelenítő képeket tudott generálni.

A Speech2Face algoritmus meglepő eredményeket ért el. Egyik sem tökéletes, viszont találunk nagyon jókat is köztük, és a valódi arcokat csak rövid audioklipek alapján rekonstruálta… Lényegében a semmiből állított elő az adott személyekre nagyjából hasonlító képeket.

Az algoritmus jól szemlélteti, hogy egy „kifinomult” MI minimális adatból, adatmorzsákból mire képes következtetni.

A kutatók óvatosságra intenek, mert a technológia nem megfelelő használatával, visszaélésekkel nagyon komoly személyiségi jogi (privacy) problémák merülhetnek fel.

„Ugyan csak színtiszta tudományos vizsgálatról van szó, fontosnak tartjuk, hogy az arcra vonatkozó információk érzékeny jellegéről és az etikai következményekről is írjunk. Minden lehetséges gyakorlati alkalmazásnál nagyon alaposan le kell tesztelni, hogy a gyakorlóanyag valóban az adott személyekre vonatkozik” – írják.

Mesterséges intelligenciájukkal nincsenek egyedül, mert a pittsburghi Carnegie Mellon Egyetemen szintén fejlesztettek a beszélő fizikai jegyeit hangfelvételből „kitaláló” algoritmust.