Egy új mélytanuló (deep learning) algoritmus szórványos adatokból generál nem létező személyekről nagyfelbontású és életnagyságú képeket. Arcuk, hajuk, testük, ruházatuk, mindenük úgy néz ki, mintha valódiak lennének.

A fejlesztés a Kyoto Egyetemen működő japán DataGrid vállalat munkája. Ezek a mesterséges intelligencia által alkotott modellek a legélethűbbek a hasonló eddigi törekvések közül. A technológiát hamarosan ruhakészítők és reklámügynökségek használhatják, fotogén modelleket dolgozhatnak ki és anélkül szerepeltethetnek különféle rendezvényeken, hogy etetni-itatni kellene őket, és fizetnének nekik.

Az MI modellt modell után hoz létre: megformálja az alakjukat, majd felöltözteti őket, de a ruhájukat is átalakítja közben. Bomberdzsekiből télikabát lesz, télikabátból különleges grafikájú ruha stb.

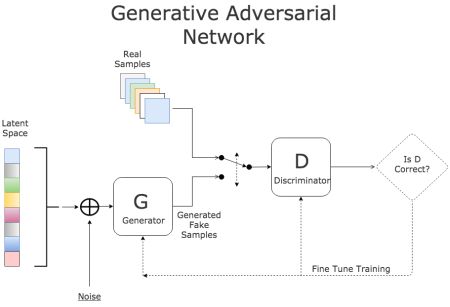

Az algoritmus a „generatív ellenséges hálózatok” (Generative Adversarial Network, GAN) technikán alapul. Ezt a mesterségesintelligencia-eljárást gyakran használják a valóságban létező tárgyak, személyek stb. utánzására, például videojátékokhoz, karikatúrához és persze kamuvideókhoz, képek manipulálásához is (például a „deep learning” – mélytanulás – és a „fake” – ál, hamis, kamu – kifejezéseket összevonó deepfake-ek esetében).

A GAN lényege, hogy a mélytanulásban két MI segít egymásnak, az egyik realisztikus képet készít például egy oroszlánról, a másik pedig elbírálja azt, megítéli, hogy a kép valódi, vagy sem. A kritikus attitűd következtében a kép folyamatosan javul, és a sokadik iteráció után tényleg valósághű lesz.

GAN technikával eddig általában arcokat generáltak, több-kevesebb sikerrel, időnként egészen bizarr végeredménnyel, például aszimmetrikus fülekkel, furcsa fogakkal, a színek meghökkentő elrendezésével.

A DataGrid rendszere az algoritmus megtévesztésére alkalmas külső infókat nem használ. A modelleket sima fehér háttér elé helyezi, és élethű fénnyel világítja meg őket.

Minden egyes alkalommal, amikor kutatók valósághű képek vagy deepfake-ek generálásra alkalmas új algoritmussal állnak elő, felmerül a kétely, hogy az MI által „teremtett” média negatív célokra, például manipulatív propagandatevékenységre is használható, és így megrendül a belé vetett bizalom. Ha a DataGrid algoritmusa a divat és a hirdetések világában marad, aligha lesz bizalomvesztés.