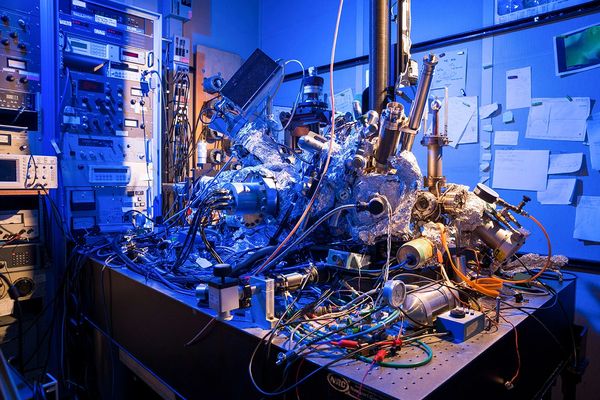

Az önvezető járműveknek a sarokban parkoló kamiontól a kereszteződés felé száguldó kerékpárosig, gyorsan és pontosan fel kell ismernie a környezetében lévő objektumokat. Masszív gépilátás-modellt kell használnia hozzá, hogy a jelenet nagyfelbontású képének összes pixelét tudja kategorizálni, mert csak így nem veszíti szem elől a – gyengébb minőségű képeken homályos, takart – tárgyakat.

Az MIT (Massachusetts Institute of Technology) és az MIT-IBM Watson AI Lab kutatói a feladat számítási komplexitását jelentősen csökkentő, az eddigieknél hatékonyabb gépilátás-modellt fejlesztettek.

A modell korlátozott hardveres erőforrással rendelkező eszközön is képes pontos szemantikai szegmentációt valósidőben végezni. Ilyen eszköz lehet például a pillanat törtrésze alatti döntéshozás lehetőségét megadó fedélzeti számítógép.

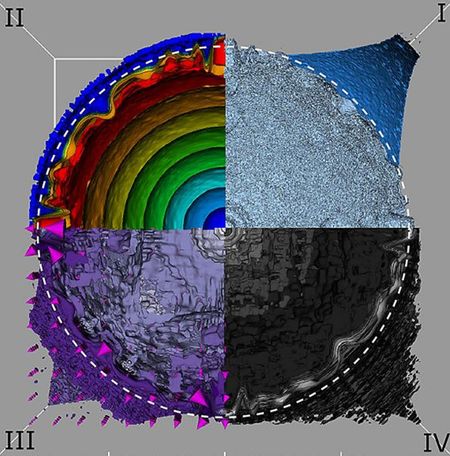

A legfejlettebb szemantikus szegmentáló modellek közvetlenül tanulják meg a kép minden egyes pixele közötti interakciókat. Nagyobb képfelbontással a számítások is jócskán növekednek, így a modellek ugyan pontosak, viszont „edge” eszközökön, például szenzorokon vagy mobiltelefonon túl lassúak nagyfelbontású képek valósidejű feldolgozásához.

A kutatók a legfejlettebb modellekkel azonos képességekkel rendelkező, viszont csak a lineáris számításokkal azonos komplexitású, tehát „hardverhatékony” műveletekre kész, új „építőelemet” terveztek szemantikus szegmentálókhoz. A nagyfelbontású gépi látáshoz fejlesztett modell, mobileszközre telepítve, kilencszer gyorsabb a korábbiaknál, viszont ugyanolyan pontos.

A modellből biztos, ami biztos alapon, teljes sorozatot készítettek.

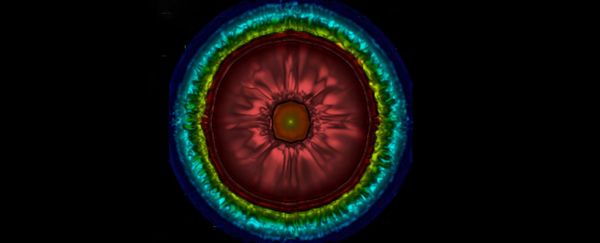

A technológiával nemcsak önvezető járművek valósidejű döntéshozása, hanem más nagyfelbontású gépilátás-feladatok, például orvosi képek szegmentálása is javítható.