Egyre valódibbnak tűnnek a mesterséges intelligencia által generált kamuvideók. Olyannyira, hogy lassan meg sem lehet majd különböztetni őket az igaziaktól; még egy MI sem lesz képes rá.

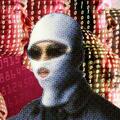

A mélytanulás (deep learning) és az álhírek (fake news) kifejezéseket összevonó deepfake gyűjtőkategória MI-alapú képszintézis technikákra vonatkozik, emberi arcokkal. X fejét ráteszik Y testére, és az adott híresség máris például lejárató pornóvideóban szerepel.

Képzeljük el, milyen következményekkel járhat, ha egy politikai vezetővel teszik ugyanezt, és az „illető” háborús vagy bármilyen sokkoló szónoklatot tart stb.

Az Egyesült Államok Fejlett Védelmi Projektek Kutatási Ügynöksége (DARPA) a világ legismertebb digitális kriminalisztikai szakértői részvételével különleges projektet szervez a nyárra. Versengeni fognak, hogy természetesen mesterséges intelligenciával melyikük hozza létre a legmeggyőzőbb kamuvideót, abszolút hitelesnek tűnő mozgóképekkel és hanggal.

A projekt azonban nem merül ki ezzel, mert a hamisítványokat automatikusan kiszűrő, legalábbis kiszűrni próbáló eszközöket is fejlesztenek. Kérdés, hogy ez mennyire fog sikerülni.

Deepfake tartalmak elkészítésében kulcsszerepet játszik, kamuvideók kiszűrését rendkívül megnehezíti a viszonylag új, a gépi tanulásban viszont máris megkerülhetetlen GAN (generatív ellenséges hálózatok, generative adversarial networks) technika, amelyben egymással szembenálló két algoritmus együttműködése teszi szinte teljesen tökéletessé a tartalmat. Az egyik alkot, a másik „kritizál”, mindkettő rengeteget tanul, és interakcióik eredményeként folyamatosan csiszolódik például egy videó. Minél több a gyakorlóadat, annál hitelesebb a kimenet.

Digitális csalásokat általában három lépésben lepleznek le. Először megvizsgálják a fájlokat, hogy találhatók-e rajtuk két kép összekombinálására utaló jelek. Utána a világítást és más fizikai jegyeket tanulmányoznak, oda nem illő elemek után kutatva. A legnehezebb a harmadik, a logikai bukfencek észrevételének automatizálása – például az adott napon és helyszínen más volt az időjárás, nem stimmel a háttér stb.

Grafikusok korábban is tudtak viszonylag meggyőző hamisítványokat készíteni, a mesterséges intelligenciával viszont a technológia szélesebb körben, állami szereplőktől Reddit felhasználókig, viszonylag csekély technikai ismerettel rendelkező userekig vált hozzáférhetővé.

A probléma túlmutat az arccserén. Egyre nehezebb lesz megállapítani, hogy egy videó, fotó, audioanyag, például telefonhívás valódi vagy sem.