Karakterek konzisztenciája, megszemélyesítése, mint szakterület, hosszú utat tett meg az első szövegből képet generáló modellek óta.

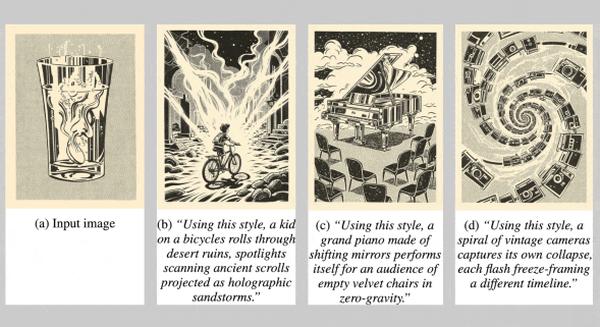

A Textual Immersion 2022-ben bemutatta, hogyan tanulható meg karakterek beágyazása, hogyan használható ez a beágyazás későbbi képek létrehozásához. A DreamBooth 2023-ban szemléltette, miként érhető el jobb eredmény a modell finomhangolásával néhány képen, és a karakter miként helyezhető új szituációkba. A képeditáló modellek rengeteget fejlődtek 2023 óta, legismertebbek a Meta Emu-Edit, az OmniGen és az OpenAI GPT Image 1-e.

Konzisztenciával és pontos editálással művészek egyedi karakterekről alkothatnak történeteket. A modellek valóban sokat javultak képeken átívelő konzisztens részletek generálásában, néha viszont hajlamosak apró részleteket, sőt, egész karaktereket és háttereket is megváltoztatni. Minél jobban segítik a felhasználói ötletek megvalósulását, annál inkább beépülnek az alkotói eszköztárba.

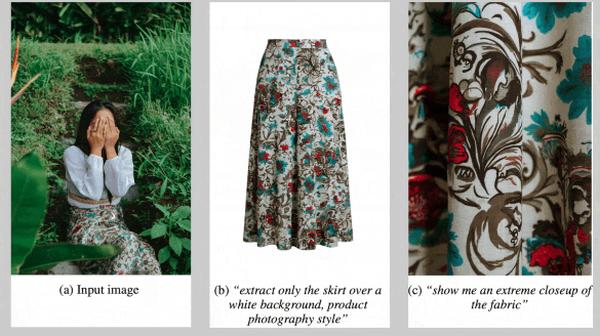

A német Black Forest Labs legújabb szöveg-kép generatív modellje, a FLUX.1 Kontext család ugyanazt a karaktert teszi új háttérbe (mint a második és a harmadik képen), végeztet új cselekvéseket vele. Ez a fejlesztés iránya. Több változatát (max, pro, dev) dolgozták ki, mindegyiket kontrollált módon gyakoroltatták be képek megváltoztatására. A dev súlyait közkinccsé akarják tenni, a licenc-feltételeket viszont még nem fogalmazták meg.

Az input szöveg, kép, az output kép. Architektúrája nem pontosított szövegkódolóból, konvolúciós neurális hálóból, képkódolóból és dekódolóból, transzformerből áll. A dev 12 milliárd paraméteres; a karakterek konzisztensek, lokális és globális módosítások végezhetők. A modellek a FLUX Playgroundon és több partneren keresztül érhetők el, a maxnál 0,08 dollár, a pronál 0,04 dollár egy kép.

A kódoló beágyazza az input szöveget/képet, a transzformer feldolgozza, a képdekódoló képeket generál. A konvolúciós ideghálót (kódoló-dekódolót) képek reprodukálására és a diszkriminátor (megkülönböztető) megtévesztésére tanították be. A transzformerrel a zaj eltávolítását, zajmentes beágyazások létrehozását gyakoroltatták be. A képek valódiságát egy második diszkriminátor állapítja meg.

A modellel csökken az input és az output közötti lépések száma. Öt riválissal mérettették meg, köztük a GPT Image 1-gyel és a Google Gemini 2.0 Flash-sel. A max és a pro mindegyiknél jobban teljesített, a dev-et csak a család másik két tagja és a GPT Image 1 előzte meg.