Egyre gyakrabban merül fel a kérdés, hogy a nagy nyelvmodellek (LLM-ek) megértik-e a világot, általánosabban fogalmazva: értenek-e valamit a valóságból a mesterségesintelligencia-rendszerek?

Egyelőre nincs semmilyen elfogadott tudományos teszt, amellyel meg lehetne válaszolni a kérdést. Andrew Ng világhírű gépitanulás-szakértő szerint az LLM-ek elég komplex világmodelleket építenek ahhoz, hogy egy bizonyos szintig elmondható róluk: értik a világot. Inkább maguktól kitalálják, milyen valójában a világ, semmint papagájként ismételnek szavakat.

Egy GPT nyelvmodellen (Othello) dolgozva, Ng és kollégái megfigyelték, hogy az általuk gyakoroltatott változat egy táblás játékot úgy értett meg, hogy senki nem magyarázta el neki a szabályokat. Rengeteg gyakorlás után viszonylag pontos előrejelzéseket tett a következő lépésekről. Vajon világmodell építésével jutott el eddig?

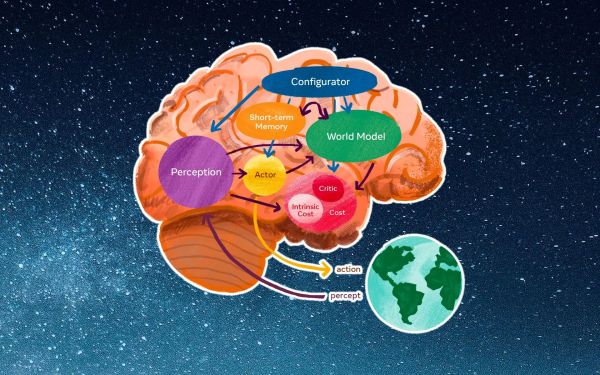

A kutatást ismertető tanulmány szerzői szerint igen. A neurális hálónak megadtak egy lépéssorozatot, mire rejtett egységeinek aktiválásával úgy tűnt, hogy rögzítették a játéktábla aktuális helyzetét és a lehetséges szabályos mozgásokat. Tehát a csak a gyakorlóadatok statisztikáit utánozni próbáló „sztochasztikus papagájjal” – meggyőző szöveg generálására jó, de az általa feldolgozott szöveget nem értő LLM – összehasonlítva, az idegháló világmodellt épített.

Ng szerint az emberi szövegen dolgozó LLM-ek szintén világmodelleket építenek. Emergens viselkedésformáikat, például megadott utasítások finomhangolását, nehezen tudjuk megmagyarázni, ha azt feltételezzük, hogy nem értik a világot.

Az MI világértése évtizedek óta vita tárgya. John Searle amerikai filozófus 1980-ban publikálta elhíresült kínai szoba érvelését. Képzeljük el azt a hipotetikus helyzetet, hogy kínaiul nem tudó angol anyanyelvű személy tartózkodik egy bezárt helyiségben, és kínaiul írt szöveget kell angolra fordítania. A fordításhoz a kínai szimbólumok mondattani rendezésére szolgáló, jelentésüket viszont nem magyarázó, angolul írt szabálykönyvet használ, aztán valahogy elkészül a fordítás. Searle szerint a számítógép olyan, mint ez a személy: úgy tűnik, érti a kínait, a valóságban azonban nem.

Az egyik ellenérv, hogy a szobában lévő személy, a szabálykönyv, papír, az ottani rendszer elemei külön-külön ugyan nem értik a kínait, együtt, komplett rendszerként viszont igen. Az agy hasonlóan működik: egyes neuronjainak fogalmuk sincs például a gépi tanulásról, de rendszerként már van.

Konklúzió: az LLM-ek is érthetik a világot. Ha nem, akkor bajosan jutunk el általános mesterséges intelligenciáig (AGI), szingularitásig.