A kínai Alibaba nyolc nagy nyelvmodellről tett közzé súlyokat. Mindegyik használ (be- és kikapcsolható) következtetőmódot. Kettő, a Qwen3-235B-A22B és a Qwen3-30B-A3B „szakértők keveréke” architektúrát használ, előbbi 235 milliárd, utóbbi 32 milliárd paraméteres, amelyekből 22, illetve 0,6 milliárd mindig aktív. A többi hat tömörített, nagy nyelvmodell (LLM) szabványokhoz képest kisebb modell, de ők is következtetnek.

A Qwen3 család közel kétszer annyi adaton alapul, mint a Qwen2.5. Több nyelven, régióspecifikus nyelvjárásokban (haiti, luxemburgi, keleti jiddis stb.) és kevésbé ismert ausztronéz nyelveken is gyakoroltatták. A hosszabb és komplexebb adatok felé tartó előképzés három szakaszt foglalt magába.

A fejlesztők hosszú gondolatláncokon (Chain-of-Thought, CoT) gyakoroltatták a modelleket. A CoT területek olyan széles skálájára vonatkozott, mint a kódolás, mérnöki tervezés, logikai következtetés, matematika, tudomány és technológia.

A feladatok sikeres elvégzését jutalmazó modell erősítette meg. A fejlesztésben lévő MI-kkel szintetikus adatokat generáltattak a nem-következtető módhoz. Ezt követően jött a saját módszertanú megerősítéses tanulás, hogy sikeresen kövessenek utasításokat, speciális formátumban hozzanak létre outputokat, és ágensekként cselekedjenek.

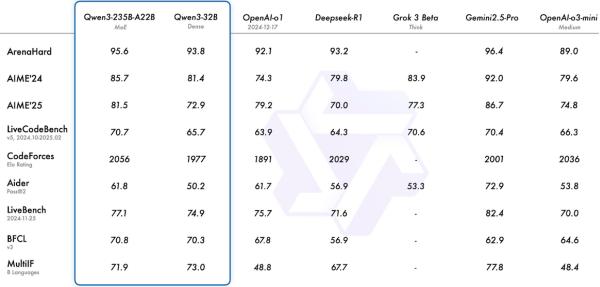

A teljesítményteszteken a Qwen3-235B-A22B és a Qwen3-30B-A3B ugyanolyan jó vagy egyenesen jobb eredményeket ért el, mint a vezető nyílt súlyú modellek. A maradék hat közül a Qwen3-4B szintén jól teljesített, a többi eredményét az Alibaba viszont nem tette közzé.

Kódolási feladatokban (LiveCodeBench, Codeforces) a Qwen3-235B-A22B az OpenAI o1-et, a DeepSeek-R1-et, a Gemini 2.5 Pro-t egyaránt felülmúlta, az OpenAI o4-mini viszont jobbnak bizonyult. Matematikai képességek és egyéb problémamegoldó kérdések terén csak a Google-modell (Gemini) vizsgázott jobban.

A Qwen3-30B-A3B a kategóriájában rivális Google és DeepSeek (V3) modelleknél jobbnak, az OpenAI GPT-40-nél viszont rosszabbnak bizonyult. A Qwen3-4B szintén kompetitív volt, a DeepSeek V3-at például két kódolási teszten is legyőzte.

Mit jelent mindez?

Elsősorban azt, hogy a Qwen3-mal folytatódik a Kínában fejlesztett nyílt súlyú és nagyteljesítményű nyelvmodellek diadalútja. Az Alibaba elmondta: úgy tervezték őket, hogy ágensrendszerekben ők gondolkodjanak. A be- és kikapcsolható következtetéssel pedig kontrollálható az ágenses és más alkalmazások költsége.