A mesterségesintelligencia-fejlesztések egyik élharcosa, a részben Elon Musk által alapított – a Tesla-vezér azóta távozott a cégtől –, sokáig nonprofit, egy ideje viszont üzleti alapon működő OpenAI körülbelül olyan fontos szerepet játszik a szakterületen, mint a Google által néhány esztendeje felvásárolt londoni DeepMind.

A két vállalat fejlesztései évről évre döbbentik meg az érdeklődőket. Ezek a fejlesztések egyrészt nagyon látványosak, másrészt, ha nem is a sokak által elvárt tempóban, hanem jóval lassabban, de közelebb visznek az emberrel azonos szintű általános mesterséges intelligenciához (artificial general intelligence, AGI).

Az OpenAI brutálisan masszív ideghálója például lefestette azt a személyt, amilyen Burger King, a burgerek királya lehet. A kép inkább ijesztő, mint szórakoztató, mindenesetre fura. A bizarr külsejű koronás személy inkább vérszomjas uralkodókat, például VIII. Henriket juttatja eszünkbe, mint békében építő, országukat felvirágoztató személyeket.

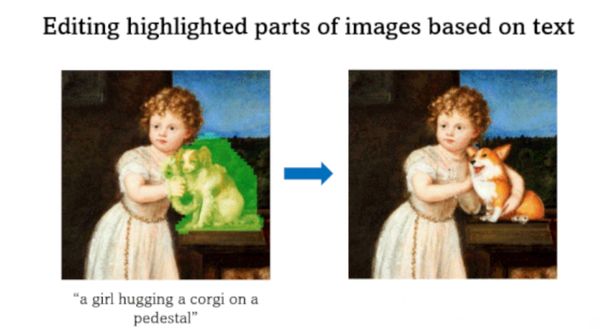

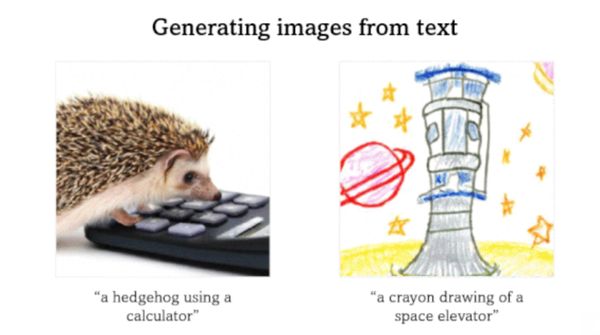

A képet generáló rendszer nem más, mint DALL-E 2, a vállalat legújabb mesterséges intelligenciája, amely egyszerű szöveges utasításokat időnként egészen elképesztő, gyönyörű és realisztikus műalkotásokká, máskor viszont ijesztő szürreális fantáziaképekké alakít át.

Az MI-kutatás egyik legizgalmasabb, több szakterületet (gépi látás, nyelvtechnológiák) összekapcsoló terepe ez, egyre több fejlesztéssel, és a mérnökök manapság már a rendszerek energiafogyasztására is jobban odafigyelnek, mint pár éve.

A kajakirályhoz az OpenAI piacmenedzsere, Adam Goldberg azt az utasítást adta az ideghálónak, hogy csináljon olajfestmény-portrét a whopperrel pózoló Burger Kingről, és a rendszer szó szerint végrehajtotta Goldberg iránymutatását, tehát sikeresnek nevezhető.

Döbbenetes, mit tudnak ma az ideghálók, milyen szintre jutott el néhány év alatt az úgynevezett generatív művészet, és kíváncsian várjuk, miről lesznek még képesek álmodni a számítógépek.