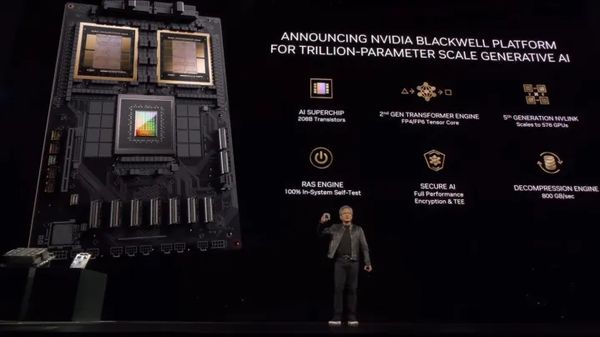

Az Nvidia éves fejlesztői konferenciáján Jensen Huang vezérigazgató arról beszélt, hogy az általános mesterséges intelligencia (artificial general intelligence, AGI) az emberiséget érintő egzisztenciális kérdéseket vet fel, mert a gépek szinte minden területen felülmúlják majd az embert: jobban gondolkoznak, tanulnak, teljesítenek. Az AGI döntéshozási folyamatának és céljainak kiszámíthatatlansága, előre-jelezhetetlensége a koncepció lényege. Elképzelhető, hogy ezek a folyamatok és célok nem egyeznek az emberével.

Sokan tartanak attól, hogy az autonómia és a képességek bizonyos szintjét elérve, az AGI ellenőrizhetetlenné válik, és olyan forgatókönyvek valósulhatnak meg, amelyekben a cselekedeteit nem lehet megjósolni, megváltoztatni.

A szenzációhajhász média az időintervallumra rákérdezve, az emberiség, de legalábbis a mostani status quo végének dátumára keres válaszokat. Az MI-vállalatok vezetői gyakran nem is reagálnak ezekre a kérdésekre.

Huang viszont igen. Szerinte sok függ attól, mit is értünk AGI-n. Több párhuzamot von, az egyikben például az időzónák bonyolultsága ellenére, mindenki tudja, hogy lesz Újév és 2025 is elkezdődik. Ha az Nvidia fejlesztői konferenciájára tartunk, a San Joséi Kongresszusi Központhoz közelítve, a hatalmas transzparensekből tudjuk, hol lesz az esemény. A lényeg: legyen valamilyen időbeli vagy térbeli közmegegyezés arról, hogyan mérjük, hogy megérkeztünk.

Ha az AGI-t speciális valamiként, például programok által kiválóan, vagy az embernél, mondjuk nyolc százalékkal jobban abszolvált tesztekkel definiáljuk, akkor Huang szerint öt év múlva itt lesz. A tesztek ügyvédi vagy orvosi vizsgák, logikaiak, gazdaságiak lehetnek. Hacsak a kérdező nem nagyon speciális az AGI a kérdés kontextusában való jelentésével kapcsolatban, Huang nem bocsátkozik előrejelzésekbe.

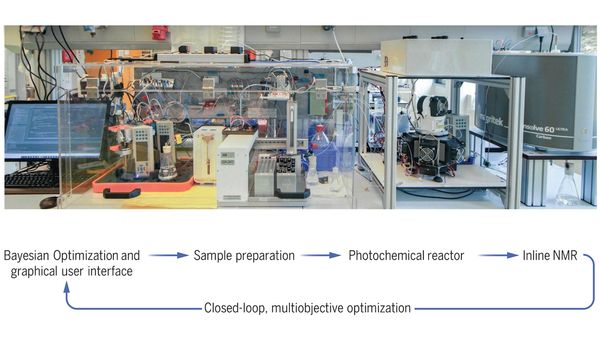

Az MI hallucinációi – amikor hihetőnek tűnő, de kitalált válaszokat ad kérdésekre – viszont könnyen kezelhetők. Biztosra kell menni, hogy a kérdés megalapozott, valós tényeken alapul. Át kell vizsgálni a forrást és a kontextust, a bennük lévő tényeket ismert igazságokkal kell összevetni, és ha a válasz a tényeket illetően teljesen vagy csak részben pontatlan, ki kell szórni a teljes forrást, és a következővel kell foglalkozni.

Az MI-nek ugyanis nemcsak válaszolnia kell, hanem kutakodnia is, hogy megállapítsa: melyik válaszok a legjobbak.

Kritikus esetekben, például egészségügyi tanácsadásnál, több és ismert forrás használandó, és a válaszadó rendelkezzen a lehetőséggel, hogy azt mondja: „nem tudom a választ”, vagy „nem tudok konszenzusra jutni.”