A tényellenőrök nem tudják tartani a tempót az egyre nagyobb mértékű félretájékoztatással, dezinformációval, és a mesterséges intelligencia sem teljesít jól online tartalmak moderálásában.

A Facebook algoritmusai például csökkentik a fogyatékkal élőknek készült hirdetések számát, ugyanakkor gyakran szemet hunynak az erőszakra való buzdítás felett. Úgy tűnik, hogy a lépésről lépésre történő fejlesztésekkel mégis tehetünk valamit az oltásellenes hangok, a klímakatasztrófa tagadása és más káros online tartalmak terjedése ellen.

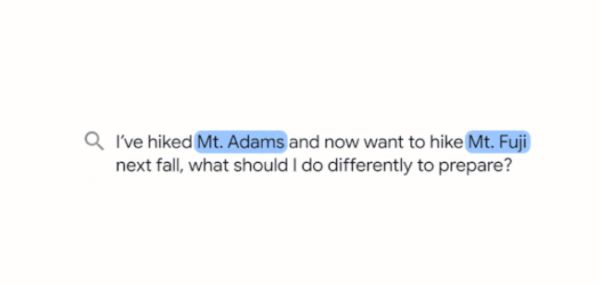

A webet elömlesztő hamis információkra reagálva, a Google frissítette a keresési eredményeket rangsoroló algoritmus mögötti egyik fontos modellt. A módosításokkal el akarják érni, hogy csökkenjen a keresési eredmények tetejéhez közeli dezinformáció. Apró, de fontos részletekről, információdarabkákról, kivonatokról (snippets) van szó.

A Google kutatói az úgynevezett Többfeladatos Egyesített Modell felülvizsgálatával igyekeznek ellenőrizni a részletek pontosságát.

A modell kiértékeli, hogy a legjobb eredmények mennyire egyeznek. Még akkor is képes összehasonlítani oldalakat egy adott témában, ha azok különböző mondatokat és példákat használnak. Ha különösebben nem bízik a rendelkezésre álló forrásokban, kivonat helyett figyelmeztetést generál, például: „úgy tűnik, nincs sok nagyon jó találat ehhez a kereséshez.”

A félrevezető kérdéseket szintén felismeri. Például az olyanokat, hogy „mikor ölte meg Snoopy Dog Abraham Lincolnt?” A frissítés máris hasznosnak bizonyult, mert negyven százalékkal csökkent az ilyen lekérdezésekre adott hibás információdarabok száma.

A Google nem az egyetlen infokom nagyvállalat, amelyik mesterséges intelligenciával próbálja szűrni a dezinformációáradatot. A Facebook multimodális tanulással igyekszik detektálni a Covid-19-cel kapcsolatos hamis állításokat. A YouTube 2020 óta használ az összeesküvéselméleteket és a tudományellenes félretájékoztatást tartalmazó videók ajánlásait leminősítő osztályozót.

Az MI összességében hasznos eszköz a keresési eredmények és maguk a keresők hitelességének megőrzésében, de egyedül nem tud megbirkózni a feladattal. Nagyjából úgy, mint ahogy az önvezető taxikkal dolgozó vállalatok is alkalmaznak (helyszíni vagy távirányító) humán sofőröket.

Az automatizált tartalommoderáló rendszereknek egyelőre komoly segítséget jelent, ha ember is van a közelükben.