Dél-Korea nemrég döntötte el, hogy a következő tíz évben 150 ezer személy végzi el a félvezető-szakértelemhez szükséges felsőoktatási tanulmányokat. Most még ambiciózusabb tervvel álltak elő: az oktatási miniszter bejelentette, hogy a következő öt évben, 2026-ig egymillióan tanulják meg, sajátítsák el azokat az ismereteket, amelyekkel a digitális ipar szakembereivé válnak.

Közben az információtechnológiai tantárgyak óraszámát az általános és a középiskolákban is megduplázzák – általános iskolákban 17-ről 34, középiskolákban 34-ről 68 órára –, és az iskoláknak számítógépes programozói tantárgyat is kötelező lesz tanítaniuk. A szoftveroktatás mellett hamarosan a mesterséges intelligencia szintén kötelező tárgy lesz.

Az Oktatási Minisztérium szerint a helyi digitális iparban (beleértve mesterséges intelligenciát, blokkláncot, mindenféle szoftvert, big datát, metaverzumot, felhőszámítást, dolgok internetét, 5 és 6G-t stb.) 738 ezer szakképzett munkaerőre lesz szükség a következő öt évben.

Mivel más iparágakban is egyre nő a digitális platformok szakértői iránti kereslet, könnyen elképzelhető, hogy a 738 ezer nem is elég, és valójában több személyre lesz igény. A keresletnek csak a digitális oktatás növelésével, minőségének javításával lehet eleget tenni.

Az egymillióból 160 ezren a felsőoktatás alapszintjét érik majd el, 710 ezren három-négyéves tanulmányokat végeznek, 130 ezren pedig a mesterképzésig, doktoriig tanulnak.

A minisztérium megszüntet a digitális szektorhoz kapcsolódó szakokra vonatkozó minden kvótát. A félvezető tanszékekhez hasonlóan ezekre a tanszékekre is felvesznek mindenkit, aki megfelel a követelményeknek.

A kapcsolódó középiskolai, főiskolai képzést mesterséges intelligenciával, virtuális valósággal, cyberbiztonsággal és big datával egészítik ki.

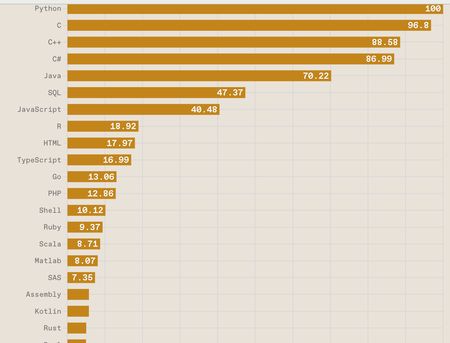

A minisztérium elképzelései alapján az általános iskolások játékszerű aktivitásokon keresztül tanulják meg a számítógépes nyelveket, a középiskolások a való világ problémáit kezelik a programozással, míg a felsőoktatásban tanulók algoritmusokat fejlesztenek majd.