Elon Musk alig két éve indult, jelenleg 75 milliárd dollár értékű xAI-ja március végén felvásárolta a multimilliárdos 33 milliárd dollárra értékelt közösségimédia-platformja, az X (az egykori Twitter) mögött álló vállalatot. Az üzlettel bővülnek az MI-fejlesztő lehetőségei, például az X adatain könnyebben trenírozhatja Grok nevű chatbotját.

„Az xAI és az X jövője összekapcsolódik. Most hivatalosan is megtesszük a lépést az adatok, modellek, számítások, elosztás és a tehetségek egybekombinálására” – jelentette ki az üzlet nyélbeütését követően Musk.

A deal több részletét nem hozták nyilvánosságra, így azt sem, hogy hogyan integrálják az X vezetőit az új cégbe, vagy mennyire szabályozzák az ellenőrzést.

Alwaleed bin Talal szaúdi herceg, az X és az xAI második legnagyobb befektetője, a Kingdom Holding tulajdonosa szerint az üzletkötés után részvényei folyamatosan emelkedni fognak. Az xAI más befektetői elmondták, hogy nem lepte meg őket a lépés, amellyel Musk megerősítette vezető szerepét saját cégeiben.

A Tesla-vezérigazgató előzetesen nem kérte a befektetők jóváhagyását, viszont közölte velük, hogy a két vállalat egy ideje szorosan együttműködik, a megállapodással pedig felgyorsul az integráció, Grok további fejlesztése.

Az üzlet egyik célja, hogy tartsák a mesterségesintelligencia-versenyt a Microsoft által támogatott OpenAI-val, a Google DeepMinddal és a kínai államot maga mögött tudó DeepSeekkel.

Musk februárban 97,4 milliárd dolláros ajánlatot tett az OpenAI-ra, amit Sam Altman CEO és az igazgatótanács értelemszerűen visszautasított. Utána bírósághoz fordult, mert szerinte az OpenAI jogtalanul vált non-profit cégből profitot termelő vállalkozássá, és hogy ezt visszafordítsa. Márciusban egy amerikai bíróság elutasította Musk keresetét.

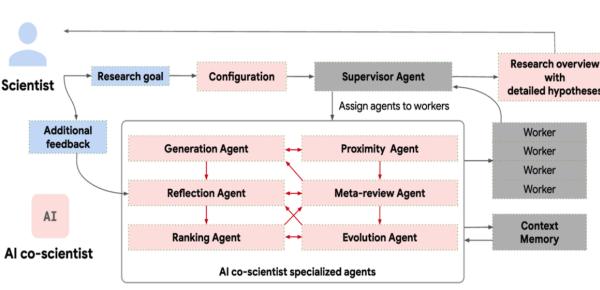

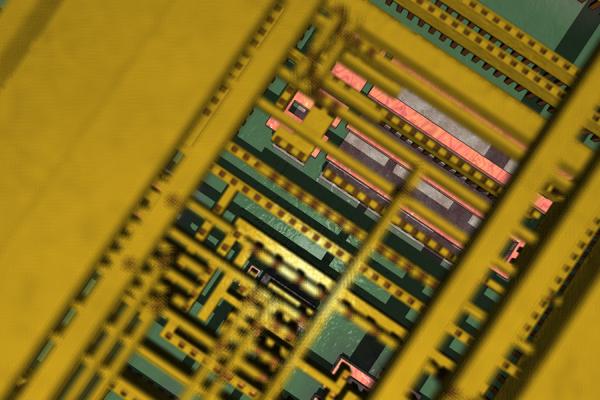

A verseny viszont napról napra fokozódik, az xAI növelte adatközpontja kapacitását, szuperszámítógépes klasztere, a memphisi (Tennessee állam) Colossus a világ legnagyobbika, a Grook-3 iterációt februárban mutatták be. Az X platform tovább népszerűsítheti az xAI termékeit, valósidőben szolgáltathat felhasználói reakciókat, képernyőképeket és más adatokat.